Google 大封鎖,步Meta狂封帳號後塵?從一隻龍蝦看AI生態

2026年開始,各種AI應用的層級明顯比去年更爲普及;尤其在前幾個禮拜MoltBot炸出一波流量後,體感上明顯看到各處開始在個人應用上開始使用自動化workflow。社群上不乏各種教程和分享,這裏就先不展開。

而這兩天冒出有用戶因為使用 OpenClaw(一個開源的 AI Agent 框架,前稱MoltBot,能透過 OAuth 串接各種服務)或是OpenCode等第三方來接入 Google 的 API(如 Antigravity 或全家桶服務),結果Google 帳號直接停權,理由通常是「疑似 API 濫用」或違反條款。連帶所有Google生態內的雲端資產都無法access。

用戶生氣氣,用戶說出來。

大致內容是,Google爲了推自家Antigravity,而限制第三方OAuth串接使用自家API,所以開始查封這類呼叫行爲的帳號;然後群衆開始把這個事件連結到去年Meta在旗下Facebook的一波大封鎖行動,抱怨四起。

這兩個事件的共同點是,一般用戶被掃到颱風(躺)尾(槍)。

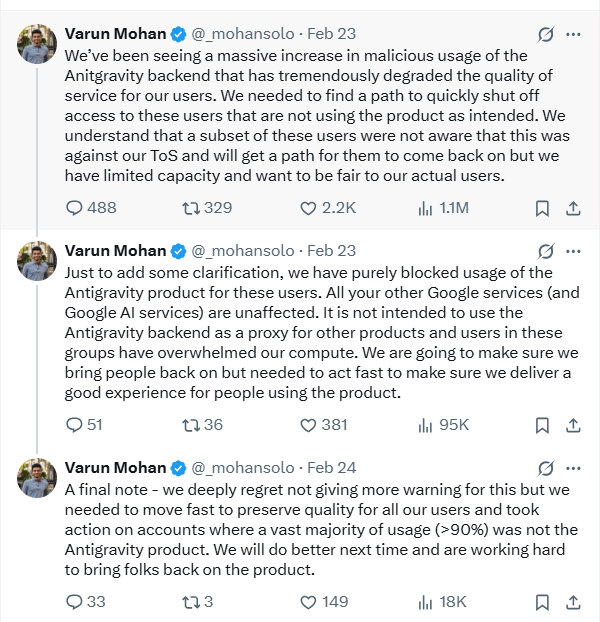

雖然Google DeepMind 產品負責人 Varun Mohan(嗯沒錯,Windsurf的co-founder)在X表示「只封 Antigravity 產品的使用權,其他 Google 服務(如 Gmail、Drive、Workspace 等)不受影響」,但是在各大社媒平臺上有零星的post指出自己的整個google account被影響。

例如這裏: 當 OpenClaw 連到 Gmail 等高敏感服務時,系統誤判為違規,導致整個帳號被 disable (X貼文)

情緒性的發言在演算法上總是特別吃香,容易發酵。🤷只是Edge case或大量發生,請自行斟酌。目前主要災情集中在使用第三方接入Antigravity的使用者帳號被封Antigravity 產品的使用權,但Google的AI Pro或Ultra方案仍舊持續扣款。

簡單來說,這個事件:

Antigravity平臺是Google自家的開發平臺,能用單一費率(例如AI Pro或Ultra)讓使用者帳號自由「配套式吃到飽」模型使用;OpenClaw使用你的使用者帳號繞過Antigravity的UI,直接從後端使用token,沒有UI延時和limit限制,嘩啦啦地任意狂刷,token使用爆量,結果就被ban了。

再簡單點比喻,

使用者買了配套,平臺讓你拿著門票在餐廳裏面悠哉悠哉地慢慢吃;結果Bot Agent直接拿著使用者門票,繞過出餐口限制(UI)跑進廚房不斷24/7吃吃吃;正常使用者在外面被壓縮分量,廚房也超負荷。

最後因爲出現這樣行爲的使用者,所以門口一看見是龍蝦拿著門票,就直接把門票給沒收了。連帶有一些已經在餐廳裡的龍蝦,因爲手上也拿著Gmail或Drive的門票,秉持著「寧可錯殺一千,不可放過一個」精神,所以一起打包驅之別院了。

爲了把用戶鎖在自家生態平臺內開發,鐵腕執行封鎖行動,ROI合理嗎?

每次在這種大規模的鐵腕行動下,背後都在走用戶情緒和實際abusive損害的鋼索。站在營運方的立場,也很難公開發表「我們無法迅速有效識別請求背後動機,所以只能從疑似相同的模式中直接扼殺」這種承認短板的言論。

我的想法是,第三方(例如openclaw)興起,只要是能促進消費,提升API使用普及,其實各大家沒什麼理由要拒絕消費者。畢竟,用戶還是透過官方通道存取雲端資源,花錢調用模型,guide rails還是在營運方手中。,理論上應該是雙贏。

舉例來說,這些工具能讓開發者更靈活整合多個服務,提升生產力,而大廠如 Google 或 Anthropic 也能從中獲取更多付費用戶流量,沒什麼理由一刀切拒絕。更不用說這種硬性封帳號的行爲在UX、CX上都是災難。

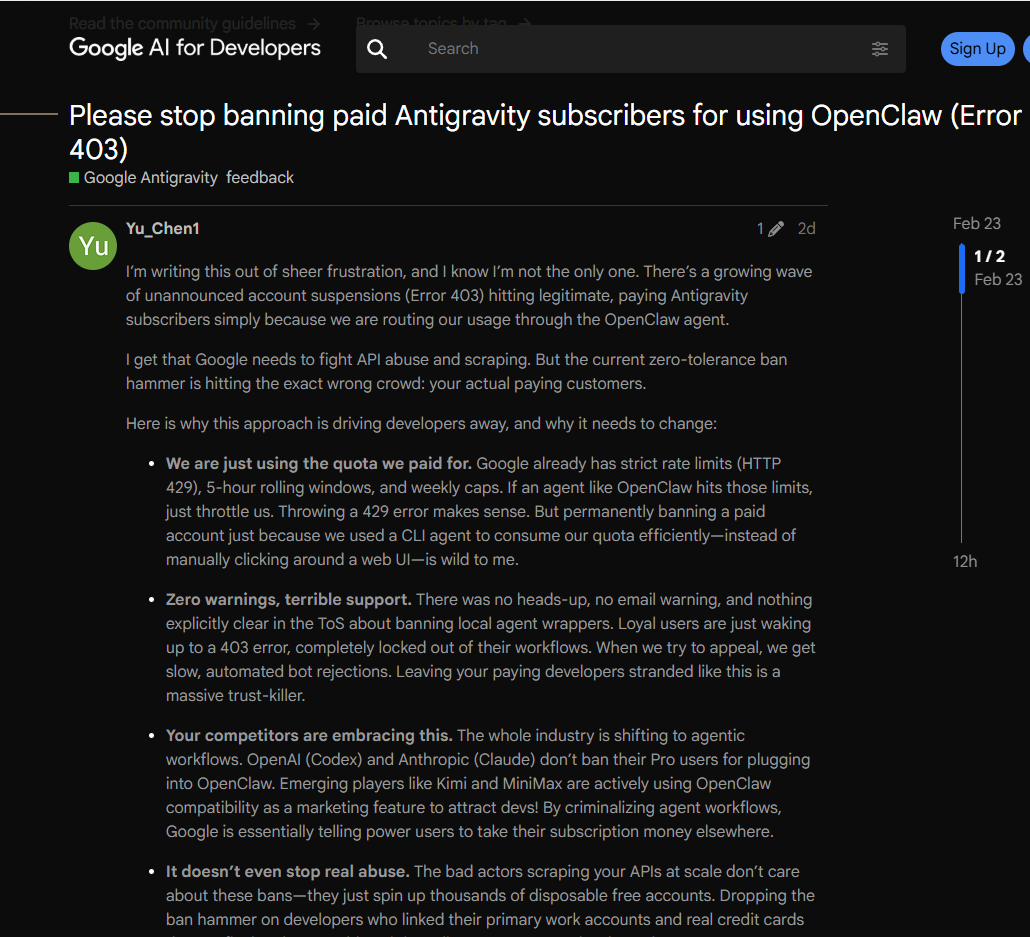

discuss.ai.google.dev 上滿是哀號,有人表示自己只是普通的使用者但卻被無預警ban掉,而沒有先 429 throttle。 The Register 和 VentureBeat 都報導,這是 Google 為了自家 Antigravity(agent-first 生態)不被第三方「劫持」流量。

同時,Peter Steinberger(OpenClaw創辦人)直接在 X 上說 Google 「pretty draconian」,並宣布下個版本移除 Antigravity 支持進行反制。他表示「Even Anthropic pings me and is nice about issues. Google just bans.」

但是,

全球“養龍蝦”的人自用能有多少,能激起營運方這樣迅速並鐵腕的反應,我只能想到是惡意使用,結果一般使用者被掃到颱風尾。尤其最近Anthropic高聲量在指出自家模型被大量quest 惡意蒸餾的時候,不禁有這種聯想。

Anthropic 其實比 Google 更早關門(1 月就後端封鎖第三方 OAuth),2 月中正式寫進 ToS。雖然 2 月 23 日的蒸餾攻擊博客才高調曝光,但 ban 的動作早在前,顯示大廠都在防『訂閱被當 proxy 狂刷』 + 『模型被偷蒸餾』的雙重風險。

AI 領域的嚴查風氣確實是從一些大規模濫用案子開始的,尤其是涉及 AI Agent 的資料刮取(scraping)、攻擊和模型蒸餾(distillation)。近日Anthropic 控訴 DeepSeek、Moonshot 和 MiniMax 進行「工業級蒸餾攻擊」(嗯,奇怪地沒提到GLM-5),用合法 API 存取來系統性複製模型邏輯。

不止Anthropic, 之前OpenAI等都在調查資料外洩。(相關文章:OpenAI Warns DeepSeek ‘Distilled’ Its AI Models, Reports - Newsweek)

Anthropic 發布了一篇官方博客,直接指控三家中國 AI 公司(DeepSeek、Moonshot AI 和 MiniMax)發起「工業規模」的蒸餾攻擊。他們創建了約 24,000 個假帳號,生成超過 1,600 萬次與 Claude 模型的互動,專門針對 Claude 的強項如代理推理(agentic reasoning)、工具使用和程式碼生成,來訓練自家模型。

文章傳送門在最末端:Detecting and preventing distillation attacks \ Anthropic (2026 年 2 月 23 日)

在工業規模互動和背後意圖相比較下,個人使用第三方Agentic手段串接API的影響就不言而喻了。畢竟數量級和影響上,單純的使用者違規可以用的手段有很多,不需要直接一刀切激起負面口碑。最重要的是,誰想要自己花大錢砸出來的前沿模型被人家廉價複製;這個直接牽動到公司競爭優勢和地緣政治。

總之,一圈逛下來,鐵腕執行封鎖行動合理,但私自猜想貌似不是單純由於一般用戶在養龍蝦的緣故。

然而,這個動作會讓整體生態更封閉,OAuth 到處串的自由度降低是事實。

一般使用者直接乖乖在規定平臺上使用,或是直接pay per token都是正常遊戲內。會因爲小路被封,開始跳腳的是誰呢?

一般使用者永遠是被犧牲的部分嗎?

🙃

很多人把 Google 這波 OpenClaw 禁令比作 Meta Facebook 之前的「亂殺帳號」後塵拿來類比:都是粗糙的自動化執法 + 無預警 + 申訴難 + 誤傷正常用戶。畢竟都涉及個人數位資產,被瞬間歸零的確使用者情緒會爆炸;但本質上Meta的那一波是內容/社群政策誤判(給社群人:嗯,羊駝亂跑),並非因爲針對公司目的性的行爲而「放羊出欄」。

一般使用者:爲什麼受傷的總是我?

各大龍頭:這是產業內的痛點,nothing personal (wink).

說到OpenClaw,OpenClaw 創辦人 Peter Steinberger 在 2026 年 2 月 14-15 日左右正式加盟 OpenAI 了。不是OpenAI買斷OpenClaw,而是他們會把OpenClaw 移到一個獨立的 open-source foundation,由 OpenAI 繼續支持,保持開放和獨立性。(從ClawdBot→Moltbot→OpenClaw 這個名字變革的時序真讓人有諸多猜想😂)

好的,其實要講的是OpenAI。

上面我們聊到Meta和Google的一般使用者被掃到颱風尾,OpenAI的ChatGPT線也有類似的味道飄出來。

OpenAI一開始就是朝AGI前進的科研公司,ChatGPT 這種消費端產品從一開始就是「順路」的副產品:用來快速驗證模型在真實世界中的表現、收集海量用戶反饋、測試邊界案例,同時產生營收支撐天價的訓練成本(compute、人才、數據中心)。他們的官方文件和領導層發言也多次強調這點,比如 Sarah Friar(CFO)在 2026 年初的博客就說,ChatGPT 一開始是 research preview,目的是「把 frontier intelligence 直接放到人們手上」來觀察會發生什麼,之後才逐步加訂閱、API 等變現方式。AGI 才是終極目標,消費端只是通往那裡的工具和現金流來源。

然而,GPT-3.5和GPT-4系列的magic moment實在是太神奇了(神奇到在GPT-4確定退役時,K也特別冒出來叨叨,傳送門:GPT-4o正式被退役:商業必要還是人道... )。使用者在被驚豔後,接下來各家消費端模型能力的百花齊放持續轟炸,開始有點麻痹,並期待OpenAI能端出更令人眼前一亮的模型。

但是如上所述,他們本身不是以消費品作爲最終導向,所以在OpenAI專注回 Frontier科研後,基數龐大的使用者開始覺得被邊緣化了。

消費者:🥹🤨😭

企業端:😎(等著,會有好戲的)

目前社群上,ChatGPT除了GPT-5.3 Codex在開發者社群炸開外,K觀察到一般使用者的風評偏向低迷;退訂的口風也不多是衆多模型能力間的選擇,而是直截了當的情緒上「不舒服」。

末端消費者的確在衆多重大決策中被第一個犧牲,不是因爲使用者不重要,相反是因爲太重要了,所以在更根本的問題上必須先做好「全套」安全規範。

不過,消費者是健忘的(沒有,沒有要舉例展開🙃),只要下一次再炸出煙花,到時候自然留存率會上來。

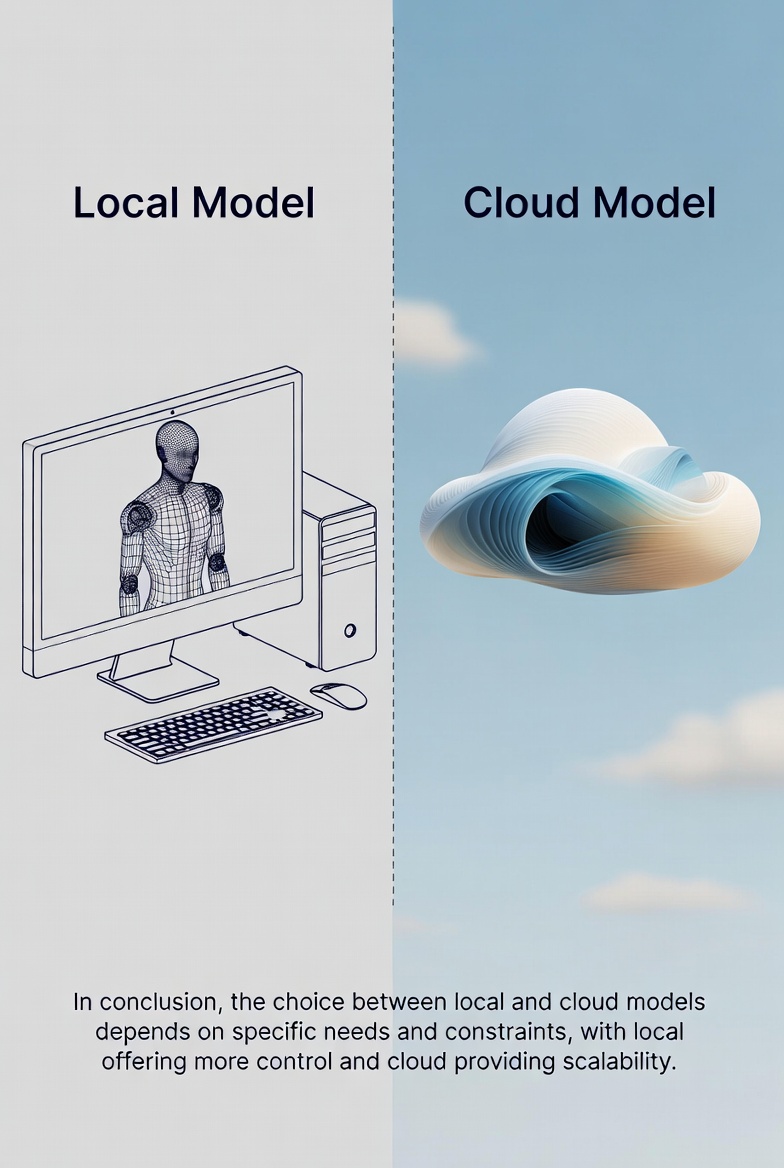

雲端模型隨時會因爲政策變動躺槍,自架本地模型是唯一解?

的確很多敏感資料和批量工作延時穩定性上,自架本地模型是最優解:能做到類似 OpenClaw 的功能(email、calendar、web 自動化),而且零 API 成本、無 ban 風險、無 OAuth 依賴。

可是,

雲端模型的收費除了模型本身token i/o,還有「一條龍」背景作業服務,各種更新維護、硬件、量化等。如果要自架部署,硬體起步費用、模型更新(新版出來要重下、重 quant)、工具整合、長期維護(模型退化、context 丟失、速度 vs. 品質 trade-off等等)變成自己要承擔這份心力。

🤔

Power User可能短期合算,但是長期要多花一份心神來維護常用(且大可能是workflow核心)的伙伴,可能要衡量一下。就門外消費端使用者如我,明顯是不合算的。

再回到OpenAI,在Peter被OpenAI秀給他看的「amazing ideas」吸引到直接推掉Meta、Microsoft 的邀約,可能和這一部分有點關係。Peter Steinberger 加盟 OpenAI 前後的訪談(如 Lex Fridman Podcast #491)和 Builders Unscripted Ep. 1(OpenAI 官方的)裡透露出很多吊人胃口的訊息。

一邊是封鎖OAuth Agentic使用,一邊是飄出Agent生態全新變革的前奏氣味,真令人期待。

以上

你好,我是K

因爲幾個社群貼文有感而發,謝謝你看到這裏。

其實這個圈子的新聞真的是以週爲單位(FOMO症重災區)。不過根據連貫時間觀察,也看到些有趣並引發聯想的現象。以下附加時間線整理:

更早(2024–2025 年):Anthropic 的 Consumer ToS 早就寫明禁止未經授權的第三方自動化工具(harnesses / agents),但那是「灰色地帶」——很多人用 Claude Pro/Max 的 OAuth token 去接 OpenClaw、OpenCode 等第三方,當成「付 $20/mo 就能無限跑 agent」的便宜方案。

2026 年 1 月 9 日左右:Anthropic 先在後端技術上動手,啟動 server-side 封鎖,讓第三方 OAuth token 無法正常呼叫 Claude(包括 OpenClaw 之類的)。這時還沒公開大張旗鼓說,但很多用戶突然發現「Claude Pro 在 OpenClaw 上壞掉了」。

2026 年 2 月 19–20 日左右:Anthropic 更新官方文件(Claude Code 的 Legal & Compliance 頁面),明確寫死:OAuth token 只准用在 Claude.ai 或 Claude Code 官方介面,任何第三方工具 / 產品 / Agent SDK 都違反 ToS。這等於正式 ban 掉用 Pro/Max 訂閱去接 OpenClaw 的玩法。媒體如 The Register、Hacker News、Reddit 都報導這是「Anthropic 正式封殺第三方訂閱認證」,Peter Steinberger 也 po 文說這是「明確違規」。

2026 年 2 月 23 日:Anthropic 才發那篇超高聲量的官方博客《Detecting and preventing distillation attacks》,公開指控 DeepSeek、Moonshot AI、MiniMax 用 24,000 個假帳號 + 超過 1,600 萬次互動,工業級蒸餾 Claude 的 agentic reasoning、tool use、coding 等強項。這件事被 CNN、VentureBeat、TechCrunch 等大媒體瘋狂轉載,變成國家安全議題(中國公司繞過出口管制,偷美國前沿模型)。

以下爲相關閱讀鏈接,如果剛好你有興趣的話:

VentureBeat 上相關的報導傳送門:

Google clamps down on Antigravity 'malicious usage', cutting off OpenClaw users in sweeping ToS enforcement move | VentureBeat

對的,裏面也有提到Peter Steinberger和Sam Altman的相關對話。

Please stop banning paid Antigravity subscribers for using OpenClaw (Error 403)

Detecting and preventing distillation attacks \ Anthropic

Anthropic 發布了一篇官方博客,直接指控三家中國 AI 公司(DeepSeek、Moonshot AI 和 MiniMax)發起「工業規模」的蒸餾攻擊。他們創建了約 24,000 個假帳號,生成超過 1,600 萬次與 Claude 模型的互動,專門針對 Claude 的強項如代理推理(agentic reasoning)、工具使用和程式碼生成,來訓練自家模型。

最後的最後,

其實站在防微杜漸的立場上的話🤔也是有可能直接作出這種迅速、全封的決策。不過因爲K剛剛看到各種新聞,所以可能想法往陰謀論偏頗了。歡迎留言提出你的看法。