你跟我說剛剛的客服不是人?!ElevenAgents Expressive Mode 讓我懷疑「人聲」!

二月才邁入第二週,手上的事情堆積如山。

K這兩天在處理手上複數個平臺糾紛,剛好遇上平臺整改,導入新的AI功能時又(對,再一次)發生UI災難,無限Loop到懷疑人生,最後終於在詭異的地方找到傳說中的VoIP「internal call」找到平臺客服。

關於這件事離奇到我覺得我只剩下兩個選擇:

1. 特地開一篇來吐槽(有沒有那麼氣😂);

2. 直接把這個UI/UX災難寫成case study公諸於世。好的,可能嘴上說說而已,忙到快冒煙了

回歸正題。

各大服務商的call center要從 AI 變成 AI?

對的,沒有筆誤。要從All Indian變成Artificial Intelligence。

沒歧視,世界上最大call center外包規模就真的是在印度。[見註]目前AI在語音助理的進展上取得顯著成長,很多公司把 routine query(密碼重置、訂單查詢、基本 troubleshooting )交給 AI agent, entry-level 職位大幅減少。簡單、固定的工作都交給AI處理,真人就業市場被大量壓縮。[見註]而剩下比較複雜的那些範濤或者edge case,很多時候還是轉交給well trained的真人客服。

和很多其他行業一樣,相當於有了汽車就不需要腳夫和馬車。

ElevenAgents Expressive Mode到底有什麼特別?

如果使用過現在主流AI Chatbot的語音功能,會發現到目前的語音回覆生成非常「有情緒」。只是在某些地方轉折或者是被barge-in中斷的時候稍稍不自然。以下連結是 ElevenLabs在20260211發佈的ElevenAgents: Expressive Mode Demo。直接把熒幕關起來盲聽試試,你會懂我在說什麼。

或搜尋:Introducing Expressive Mode for ElevenAgents

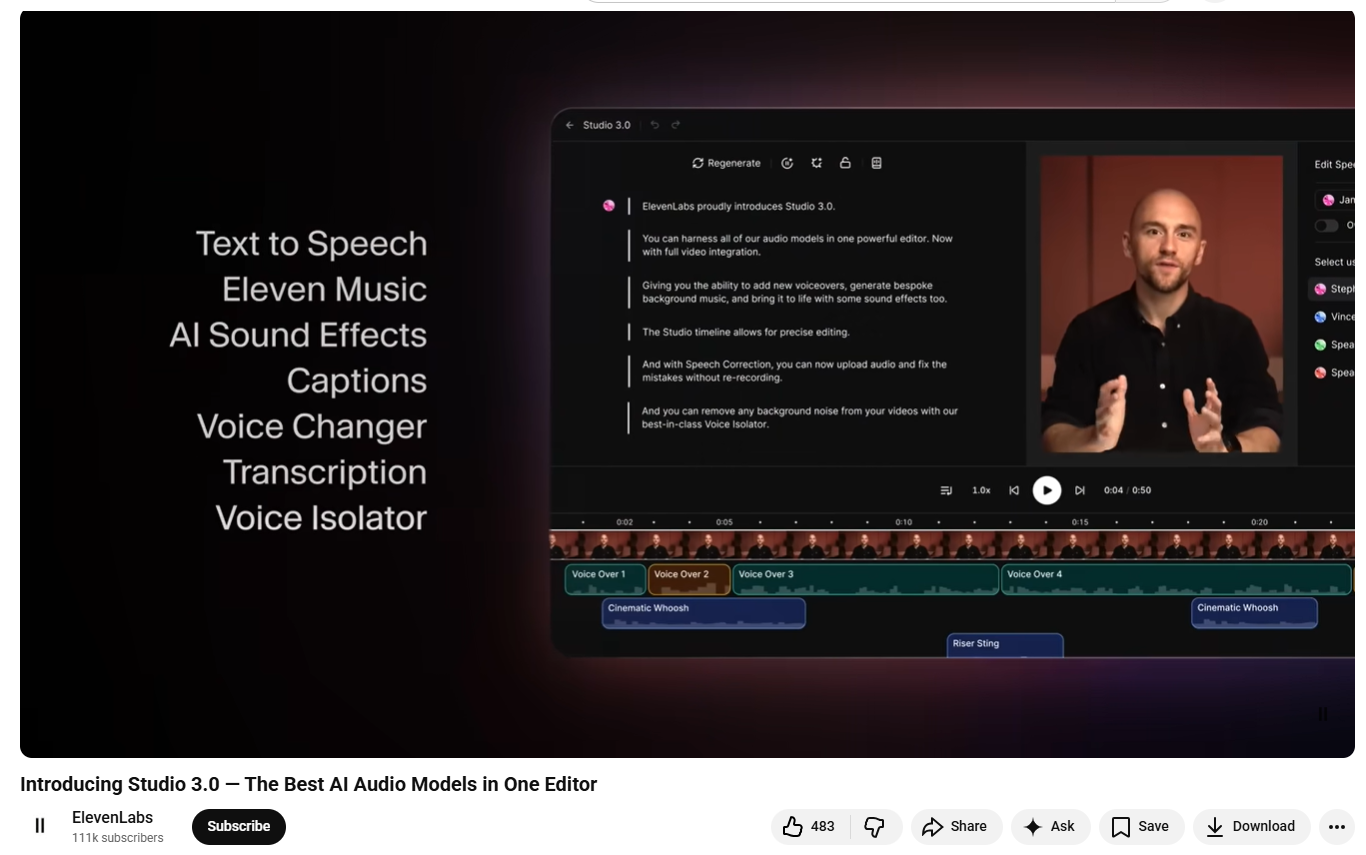

ElevenLabs是目前 AI 語音領域最頂尖的公司之一,總部位於英國/美國,主要產品就是生成極度逼真的人類語音(Text-to-Speech, TTS),被很多人稱為「目前最像真人的 AI 配音」。

支援超強情感表達、語調控制、多角色對話,甚至能透過簡單標籤控制語氣;還支援包含中文和粵語等70+種語言。更特出的是,還能自己訓練克隆聲音(Voice Cloning)。

除了一般TTS(Text-to-Speech)、語音轉文字(Speech-to-Text);還有音樂生成、對話生成(Text to Dialogue)、影片/圖片生成整合、專業配音工具(Dubbing、Voiceover Studio)等強大功能。對於YouTuber、影視後製、遊戲、播客、有聲書、企業客服、行銷內容創作等來說,不用顧人(聲優)的成本和真人服務配合的時間,的確是如虎添翼。

但沒錯,又是另一種產業沖擊。雖然台灣的配音產業的確本來就沒有很蓬勃。

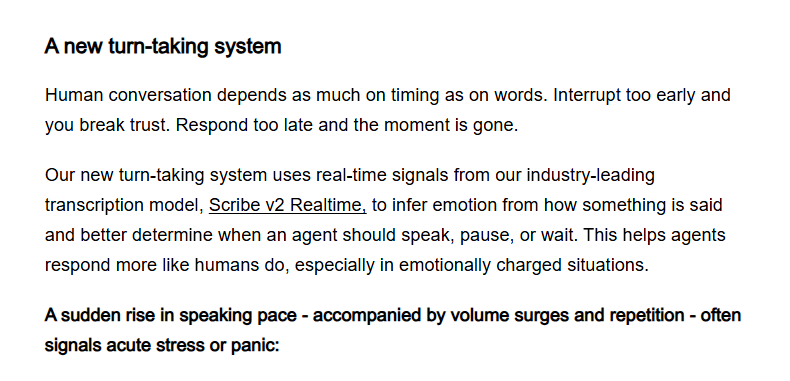

雖然官方釋出影片中沒有像之前中國模型進行現場打斷(嗯,吵架)或是像Grok語音模式現場示範,但是在一些第三方或開發者影片(如用 ElevenLabs + local STT 做的 realtime chat demo)裡,有明確展示按鍵或語音打斷 Agent, Agent 會立刻停下來聽你講,感覺很像真人被打斷後「好,你說」的那種反應。

官方文件和 Conversational AI 2.0 blog(2026 年 1 月)都強調這是核心賣點:避免傳統系統「講完才聽你」的僵硬感。延時超低,且可調。Eleven Agent 是 ElevenLabs 在 2025 年底~2026 年大力推的第二大產品線,簡單講就是「會講話的 AI 客服 / AI 助理 / AI 代理人」,支援32+ 語言 的自然對話,並可自定義串接外部工具(tool calling)、知識庫、企業資料。

丟回上面講的客服場景,嗯,有點「哇噻」。這個「哇噻」一部分給entry level的就業市場,一部分給使用者體驗,最後才是技術向。(是的,這個年頭大家都對新進步快速進展的節奏有點麻痹了)

是誰在說話真的重要嗎?

就使用者核心需求來說,最重要的是get things done。AI Agent在get things done的同時,追求beautifully done、seamlessly done。

客服需要像人(或被認爲是人),個人觀點是因爲目前世代對「和機器」講話、「機器像人」有種不適。時常跟各種客服打交道的人來說(嗯哼),在實務需求上快速把事情解決的需求權重比「對方是不是人」重要的多。大家都在時間的滾輪上賽跑,誰能超前一點把事幹完,誰相對能休息的時間就多一點(或保持不被超車)。

話說回來,這兩天K在和無限loop的客服redirect打架後,終於通了30分鐘的電話「get things done」;回頭就看見Eleven Agent的Demo影片,突然覺得剛剛通話的agent的咳嗽、忙碌的背景聲和貌似人類特有的思路打結,有可能都不是真人。

但是我不管,事情做完我就自動從線上系統滾蛋,不佔誰的資源(包含我自己的)。

去年的確看到新聞指出,AI 語音客服上線後,很多真人客服爲了暗示自己是真人以降低client的反感度,作出咳嗽、重複、清喉等聲響。這些手段在2026年以後恐怕也將不適用。

的確,這次面世的Eleven Agent 已經可以輕鬆加入故意咳嗽、重複、嗯啊、吸氣、吞口水這些「human imperfections」,而且效果非常強。想想,克隆一個口音再加點微調,誰知道電話對面是誰🤷

其實還有點關於ElevenLabs模型、MCP、AI在現代使用模式的影響想講,不過那種碎碎唸就留給下次(?)吧。

回到開頭的平臺UI/UX災難,有空做成case study吧🙈 至少是「看起來有觀點的吐槽」(實際上還是吐槽)😂

以上。

你好,我是K

謝謝你看到這裏,你真的很厲害👍

註:

NASSCOM 2024 數據:印度貢獻了全球 BPO 市場收入的 約 56%,擁有超過 4.3 百萬名專業人員,並且有超過 500 家主要外包公司。這使印度成為全球最大的 BPO 樞紐。Top 20 BPO Companies in India 2025 | Globalify

Globalify 2025 報告:印度仍然是全球首屈一指的 BPO 目的地,掌握了 超過 55% 的全球外包市場份額,市場規模達 478 億美元,員工超過 450 萬人。Top 10 BPO Companies in India (2025 Updated List) Top 10 BPO Companies in India (2025 Updated List)

AI could wipe out millions of jobs in India by 2027: Vaibhav Sisinty AI could wipe out millions of jobs in India by 2027: Vaibhav Sisinty | Sharan Hegde posted on the topic | LinkedIn