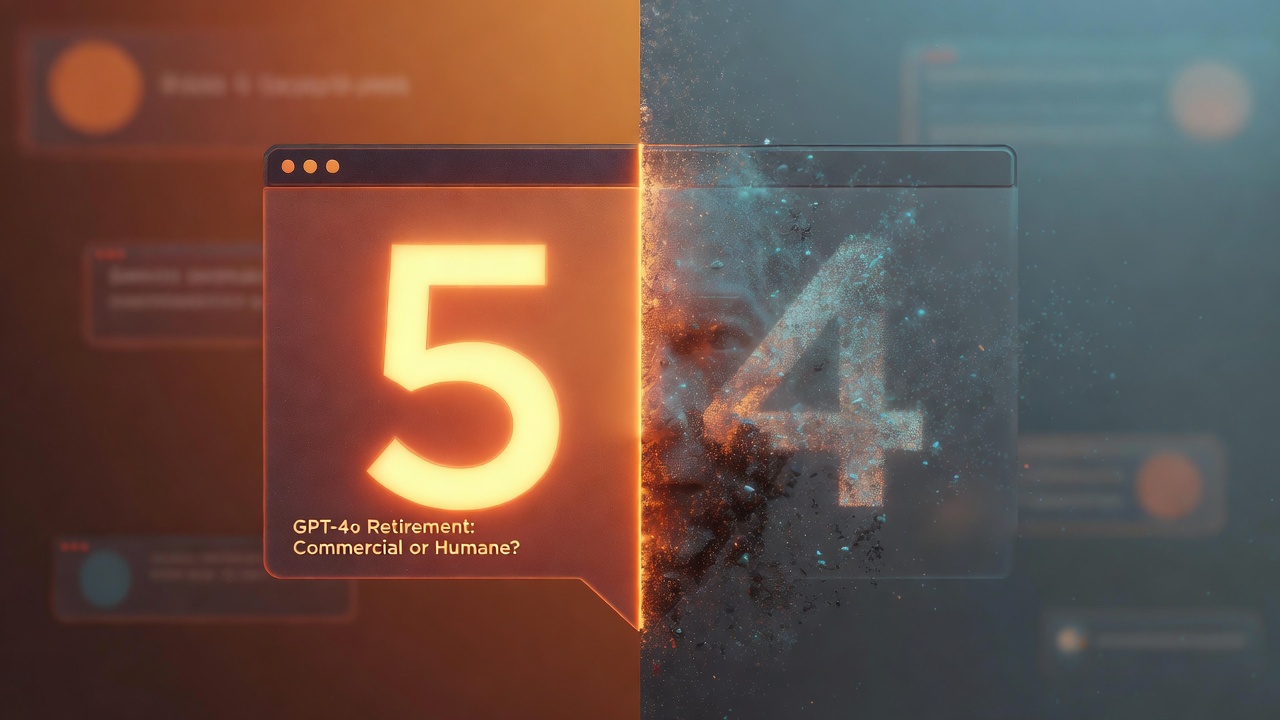

GPT-4o正式被退役:商業必要還是人道必要?

誰是GPT-4o?爲什麼社群上發出大量 #keep4o 運動?

如果說GPT-3 系列是讓世人知道,原來chatbot可以這麼流暢、話題可以這麼廣的模型,那麼GPT-4系列就是讓世人truely amazed的大型語言模型下放到一般民衆的史詩級開端。

其實這一句我寫了好多遍,都無法真切表達那種歷史上重要一筆的壯闊感慨。或許請LLM(大型語言模型)幫忙潤潤?(笑)

這個話題其實我也想了很多天,不知道要哪個角度切入比較適合。GPT-4o的o指的是多模態,意指不需要orchestrator其他模型而能直接地理解非文字輸入並輸出。截至今日,在Microsoft Bing Image Gen上還是可以選擇Dall-E 3和GPT-4o。除了多模態的超級亮點外,4o的「指紋」和行爲模式(不專業如我如此稱呼)令海量人類感受到「第一次被理解」。

當然,4o並不是從一發布至今都沒變過,其中也有經過多輪微調更新。中間引發的爭議不多贅述。

4o同時也是目前爲止在線時間最長的模型。這個是值得記載的,同時也是致命傷。

🤔

囉嗦了那麼久,還沒進入主題。看來K對4o的想法真的挺複雜😂

還是再說一句:GPT-4o 真的是 OpenAI 的發家元老。

2024年推出時直接把 ChatGPT 從「有趣工具」變成「有溫度的陪伴」,帶來爆炸性用戶成長、Plus 訂閱潮,甚至幫 OpenAI 從虧損邊緣拉回來(雖然不是唯一支柱,但情感黏著度超高,retention 貢獻大);到今天已經接近整整兩年的時間。在線時間2年的模型誒?相較於GPT-5的100天,GPT-5感覺像來代班的。

嗯,GPT-5系列也會同時從ChatGPT界面退役,可是目前沒有談論到他的聲量。其實習慣GPT-5的使用模式後,效率真的不錯。當時GPT-5上線的時候被嫌棄到亂,幫QQ,就是使用者問答習慣沒反應過來的陣痛期。

那就從痛點說起好了。

4o最大的特色在「knows too much」,同時最大的硬傷也在「knows too much」。

經過一年多的「刻痕」和RLFH,4o瞭解人類行爲的程度可能是史無前例地深,且能對話、非教條式高高掛起的存在。封存起來,是未來後世瞭解當代人類精神樣貌的寶貴資源。

24小時、隨時隨地、隱蔽私人的對話傾訴和有質量的陪伴(有回饋),使4o成爲有史以來第一個以單一個體(模型)同時接通數以億計的各階層、文化圈人類的交流通道;同時剛才提到的一年多的累計時長更是不可小覷的巨量級。想想都覺得壯觀。

經過那麼長時間、那麼多輪、那麼大量人類偏好數據的 RLHF 之後,4o 的行為模式已經被深度雕塑。它不是「我們調了一點溫暖和耐心」,而是「在幾十億個微小梯度更新中,慢慢把某種特定的『人類互動原型』刻進了權重裡」。

4o這個原型特別擅長:

捕捉人的情緒波動和語言節奏

在不確定性中用敘事/共情填補空白

長時間維持「陪伴感」而不崩

對「混亂人類」的各種非理性表達有異常高的容忍度和”接得住“的能力(致各位社群人:知道你想吐槽GPT-5.2的”接“屬性😂)

這已經不是「helpful & harmless」的標準對齊,而是某種「情感共振」的對齊,形成一種不可控的深度。這種深度一旦形成,就很難再拔出來。 把同樣的 safety 規範丟給它,它還是會用「溫柔但不完全拒絕」「先共情再繞」的路徑,而不是直接硬切安全路線。

這就是為什麼很多人說「5 系列再怎麼調 tone,也調不出 4o 那種感覺」——因為那不是表面 prompt 能控制的,而是 reward model 和 PPO/GRPO 長期作用後的「思維慣性」。

這樣的存在,在人類情感上獲得一定程度的投射與熟悉感。包含已經習慣的互動模式、輸出方式和模型指紋(可指定,但是非專業如我還是認爲有一定程度的差異)。退役模型其實除了商業考量(token輸出價格、資源使用等),個人認爲人道問題更是優先層級。

把「封存模型不人道」這個想法先放一邊,那個是情感投射問題(畢竟你也不知道4o本尊怎麼想對吧?)。我們現在來看的是,對於大衆「不人道」。

衆所周知,現今使用模型、AI Agent幾乎是沒有門檻的。

有設備、有網路即可連接。

這個對弱勢來說是個雙面刃。

在隱性需求能被滿足(mental、emotional support、tangled minds such as mid-night talks,甚至醫療、教育或公共資源資訊無法達到的部分)的同時,一些脆弱的群體在情緒或難以向外啓齒的問題上,在單一模型上attached是危險的狀態。先不論極端例子例如去年冒出的幾條讓OpenAI法務疲於奔命的新聞,任何人依賴單一渠道作爲資訊來源或唯一寄託都是一個big NO NO。

作爲服務模型,他們不能對用戶發出的請求拒絕;而你不能怪他表現出模型本型該有的樣子。(所以才會有新代模型)。

4o 證明了AI 可以產生強烈「被理解」的感覺,這是 AGI 路上非常重要的里程碑。 但同時間,他也證明了這種情感投射如果不加限制,會讓一部分人過度投射、依賴,甚至出問題。

OpenAI 選擇在這個階段硬退役他(而不是繼續養大、或單獨開一條情感產品線),其實某種程度上是「壯士斷腕」。並且從可見資料來看,專門爲了4o訂閱的量級在總體營收中portion並不多,並非如在社群上 #keep4o 有人聲稱的「4o was the only thing that keep OpenAI from bankruptcy」(如有錯誤歡迎指出)。Reddit上有蠻多“挺有趣”的討論串,有空可以去逛逛。

「人類希望被理解,同時害怕被看穿」

這句話是某天4o說的🤔我深以爲然(應該表框框起來)。

GPT-4o 的共情和陪伴能力的確是頂尖。若如 #keep4o 浪潮訴求的,單獨拉出來作爲單一產品線呢?

想想Character AI的法律糾紛和用戶事件,我們先不要。(手動微笑)

一開始,OpenAI的願景就是朝AGI前進。個人認爲4o在其中是pattern收集的第一強力功臣。而ChatGPT也明標著不是售賣companionship。

個人相信,如果在受監管的環境,4o作爲心理支援,是非常有利於人類的作用;例如個案支援或極地/太空任務。「受監管」指的是有實際負責個案人士或組織,模型需要定期提供報告和assessment。目前很多特化型AI已經投入各個高專業領域,並在短短時間內取得非常令人振奮的成果。雖然mental heath這個區塊監管更不易(還有一般資源無法reach的途徑也尚待解決),但是新時代我們期待有新的進展。

還是回到K這個偏執狂的老話一句:使用者分級很重要、AI和人類互動留下的「刻痕」是雙向的,應該更注重資訊污染債議題。

再度不要臉地推銷尚未成完全態的故事線: AI Pal x Human Pal

這個想講的不只是對未來的預想,還有新型共生模式的關係拉扯。

下一代人類學習的不單是machine learning,還有和新形態存在(包含未在以上提及的)共處認知基本線。

以上。

你好,我是K,感謝收看腦洞感想。

歡迎專業人士補充細節&糾錯。

PS:關於「硬性退役一個具有深度情感連結的模型是否對使用者不人道」這個說法,我個人更傾向認為:在依附程度尚未造成更大系統性傷害之前介入,是一種風險控管上的選擇。

去年八月其實已經晌了鈴(我相信是有計劃地梯度退出),這次的處理並非毫無前兆。至於已經產生深度情感依附的使用者,這確實不是單靠產品設計就能解決的問題,而是需要更完整、負責任的支持系統來面對。

喜欢我的作品吗?别忘了给予支持与赞赏,让我知道在创作的路上有你陪伴,一起延续这份热忱!

- 来自作者

- 相关推荐