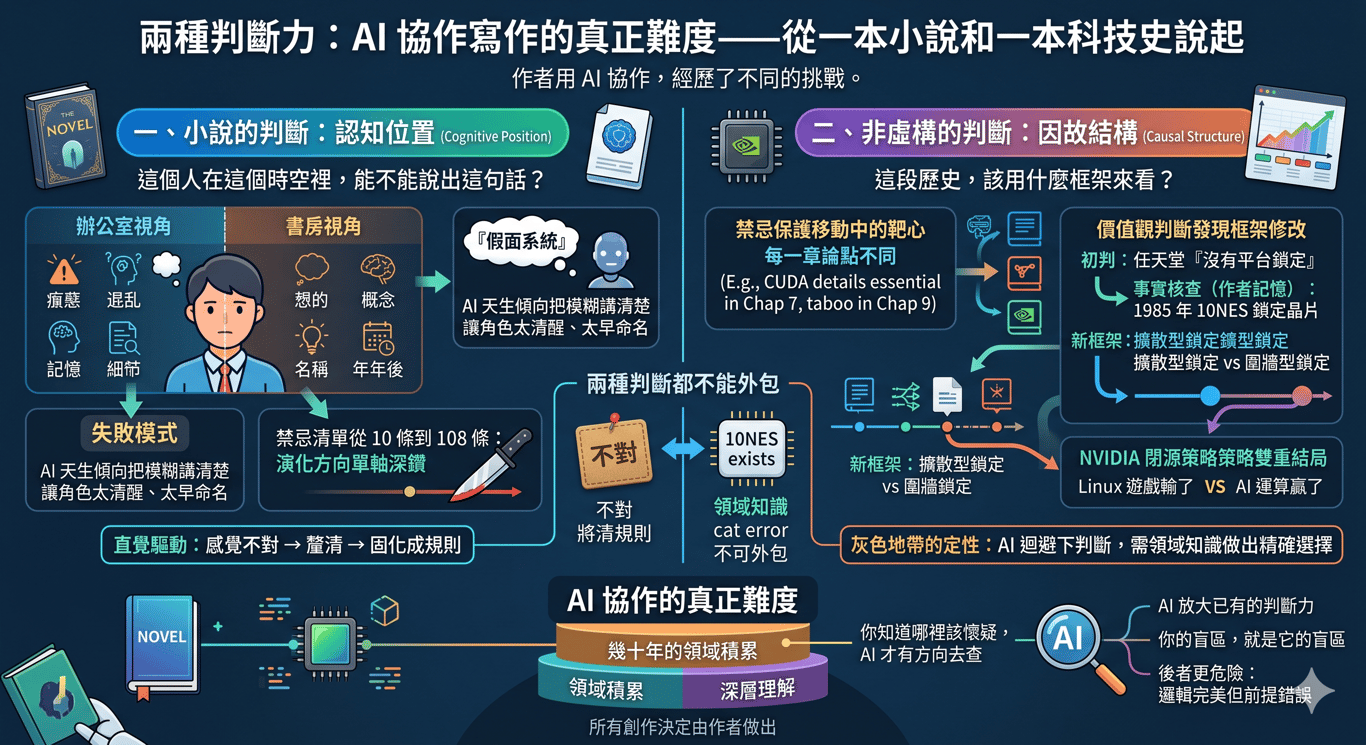

AI 協作寫作的真正難度——從一本小說和一本科技史說起

兩種判斷力

我用 AI 寫了兩本書。

第一本寫一個工程師在職場系統裡被碾壓、事後才看清全貌的故事。第二本是《遊戲致勝》,繁體中文非虛構,副題是「從像素到 AI,娛樂如何暗中重塑全球科技霸權」——追溯過去四十年的 PC 遊戲史,論證每一次科技霸權的重大轉向,骨子裡都是一群想玩更好遊戲的人意外推動的結果。

兩本書都用了 AI 做共同協作。兩本書都不是「叫 AI 寫稿、人類修改」的模式。兩本書都需要一套不斷演化的寫作指令。

但它們的難度結構完全不同。

因為「判斷」這個詞,在兩本書裡指的是完全不同的東西。

一、小說的判斷:這個人在這個時空裡,能不能說出這句話?

小說有一條寫作禁忌:「林昭明不可以在辦公室裡命名抽象概念。」背後是整本書的認知設計。小說分成辦公室視角和書房視角。辦公室裡的主角只能感受、困惑、記住細節。把感受變成概念——命名——是書房的特權,是多年後回望時才有的能力。

如果 AI 在辦公室場景裡讓主角說出「假面系統」這四個字,整本書的認知弧線就崩了。

這條規則不是第一天就有的。是寫到某一章,AI 產出了一段「技術上沒有錯、語法通順、邏輯合理」的文字,我讀完覺得不對——花了半天才釐清:不對的地方不是措辭,是認知位置。主角不是不會說那些詞,是他在那個時空裡還沒有到達可以說的位置。

這就是小說裡「判斷」的本質:判斷的對象是認知位置。 角色在這一刻知道什麼、不知道什麼、以為自己知道什麼。AI 的失敗模式是讓角色太清醒、太早命名、太有主體性——因為 AI 天生傾向把模糊的東西講清楚。而小說需要的恰恰是保持那個模糊。

一百零八條禁忌,全部在做同一件事:防止 AI 踩過一條認知邊界。方向從第一天起就鎖定了——寫一個被系統碾壓的人怎麼在事後才看清全貌。規則越加越細,但它們保護的始終是同一個東西。

二、非虛構的判斷:這段歷史,該用什麼框架來看?

《遊戲致勝》的寫作指令裡也有禁忌。五條:禁懷舊腔、禁學術腔、禁手冊腔、禁溫情結尾、禁名單羅列。

但這五條禁忌保護的不是一個固定的認知位置。它們保護的是一個移動中的靶心——每一章的論點不同,「什麼算手冊腔」的邊界每次都不一樣。

CUDA 四層鎖的技術細節在第七章是論點的核心武器。同樣的細節如果出現在第九章 Lisa Su 的章節裡,就是手冊腔——因為第九章的論點不需要它。AI 不會自己做這個區分。我得在每一章開始之前,重新校準「細節服務論點」的邊界在哪裡。

但這還不是最難的部分。最難的部分是:非虛構寫作裡的價值觀判斷,不是保護一個已知的立場,是在寫作過程中發現立場本身需要修改。

舉一個具體的例子。

《遊戲致勝》第十一章寫任天堂和世嘉。終章第四版(v4)裡有一句話:「世嘉和任天堂——唯二沒有建立平台鎖定的公司——一個死了,一個活在孤島上。」

這句話在寫下去的時候,我覺得它是對的。它整齊、有力、跟前十章的 pattern 形成漂亮的對比。

然後我自己想起來:任天堂在 1985 年就在 NES 卡帶裡植入了 10NES 鎖定晶片——比微軟的 DirectX 早十年。它的授權制度之嚴苛,在同時代無人能出其右。

「沒有建立平台鎖定」這個判斷是錯的。

但修正不是簡單地把「沒有」改成「有」。如果任天堂「有鎖」,那它跟微軟的 DirectX、NVIDIA 的 CUDA 有什麼不同?為什麼它鎖了四十年卻沒有成為科技霸權的基礎設施?

這個問題逼出了一個全新的分析框架:擴散型鎖定 vs 圍牆型鎖定。

DirectX 的鎖向外擴散——從 PC 遊戲穿透到整個 Windows 開發生態。CUDA 的鎖向外擴散——從遊戲 GPU 穿透到全球 AI 基礎設施。任天堂的鎖不向外擴散——邊界止於自家平台,從不試圖讓自己的技術標準成為產業標準。

這個框架不是事實核查查出來的。事實核查只告訴我「任天堂有鎖」。「擴散型 vs 圍牆型」這個分類維度,是我在修正事實錯誤的過程中,被迫做出的一個價值觀判斷:我選擇用什麼維度來看鎖。

這個判斷改變了終章的整個結構。「八次變奏,一次缺席」變成了「八次擴散,一次圍牆,一次無鎖。」計數變了。鏡子段落變了。全書的隱藏脊椎從一條變成兩條。

小說不會發生這種事。小說的認知框架在大綱定下來之後基本穩定——你需要保護它,但你不需要在寫作過程中重建它。非虛構的框架會被自己的發現反覆改造。

三、兩種判斷都不能外包,但出錯的方式完全不同

小說的判斷出錯,你通常能感覺到。

AI 讓角色在辦公室裡命名了一個概念,你讀完會覺得「不對」——即使你一開始說不清哪裡不對。那個「不對」的直覺是可靠的,因為你是故事的作者,你知道這個人在這個時空裡應該是什麼狀態。你的工作是把直覺翻譯成規則。過程很慢,但方向是確定的。

非虛構的判斷出錯,你有時候感覺不到——而且 AI 也幫不了你。

「任天堂沒有建立平台鎖定」——這句話寫下去的時候,我覺得它是對的。它在邏輯上自洽、在敘事上漂亮、跟前十章的 pattern 形成整齊的對比。AI 也覺得它是對的。如果我叫 AI 去「核查這一段有沒有事實錯誤」,它不會觸發任何警報——因為 AI 的知識庫裡,「任天堂」和「平台鎖定」這兩個詞之間的關聯強度,遠低於「微軟」和「平台鎖定」。

發現這句話有問題的人,是我。不是 AI。

我知道 1985 年的 NES 卡帶裡有一顆 10NES 鎖定晶片。我知道任天堂的授權制度在同時代嚴苛到開發商怨聲載道。這是我自己的領域知識——幾十年累積的、關於遊戲硬體史的底層認知。正是因為我知道這些,我才能在讀到「沒有建立平台鎖定」的時候,從自己的記憶裡撈出一個反例。

AI 撈不出這個反例。它不是不會搜尋——是它不知道該搜什麼。「任天堂有沒有平台鎖定?」這個問題,只有在你已經懷疑答案的時候才會問。而懷疑的前提,是你自己先知道 10NES 存在。

NVIDIA 閉源驅動跟 Linux 遊戲的關係也是同一個結構。第六章寫 Valve 為什麼選 AMD 而不選 NVIDIA 做 Steam Deck 的 GPU 合作夥伴——這個判斷的基礎是我知道 NVIDIA 的 Linux 驅動是閉源的、而 AMD 的是開源的、而 Valve 需要端到端控制翻譯管線。AI 可以幫我查 GPU 驅動的開源狀態,但「開源 vs 閉源的差異會影響 Valve 的平台選擇」這條因果鏈,是我自己搭起來的。AI 不會主動搭這條線——因為它不知道這條線重要。

這是非虛構寫作特有的一種危險:一個錯誤的事實前提,可以支撐一個邏輯完美的錯誤論點。而邏輯越完美,你越不會懷疑前提。 AI 的事實核查只能在你指對方向的前提下才有用。如果你自己不知道任天堂有 10NES,再跑幾輪核查都不會觸發那個問題。

那 AI 能幫上忙的事實核查是什麼?是具體數字的驗證。第七章(CUDA)交付後,我知道哪些數字需要查——CUDA 1.0 的發佈年份、Tesla GPU 的命名脈絡、cuDNN 的起始年份、GeForce 8800 GTX 的定價——然後讓 AI 去逐條比對。結果查出四個錯誤。這些不是風格漂移,是硬傷。但重點是:我得先知道要查什麼,AI 才能幫我查。

小說的禁忌清單靠直覺驅動——感覺不對 → 釐清 → 固化成規則。非虛構的守門人不是 AI 的核查程序,是作者自己的領域知識。你知道哪裡該懷疑,AI 才有方向去查。你不知道的地方,AI 跟你一起盲。

四、科技史不是非黑即白——而 AI 天生想把灰色變成黑白

非虛構寫作裡還有一種判斷,跟小說完全不同:對灰色地帶的定性。

「NVIDIA 的閉源策略是好是壞?」

如果你問 AI 這個問題,它會給你一個平衡的答案:「閉源有優點也有缺點,要看具體情境。」技術上沒錯,但完全沒用。

《遊戲致勝》裡的判斷是:NVIDIA 的閉源策略在兩個戰場得到了完全相反的結果。在 Linux 遊戲硬體上,閉源讓它輸了——Valve 需要端到端控制翻譯管線,閉源驅動阻止了這件事,所以 Valve 選了 AMD。在 AI 運算上,同一套閉源策略讓它贏了——CUDA 的鎖深到四層,AMD 驅動層再怎麼開源也碰不到上面三層。

同一家公司、同一套策略、兩個相反的結果。 這個判斷不是「平衡」的——它是精確的。它拒絕了「開源好 vs 閉源壞」的道德簡化,但它也不是含糊的兩面論。它明確指出:鎖的深度決定了策略的效果。

AI 做不了這個判斷。不是因為它不夠聰明——是因為這個判斷需要你先看穿第六章和第七章之間的暗線,而那條暗線是在寫作過程中才浮現的。你不可能在第一天就把「NVIDIA 閉源策略的雙重結局」寫進 prompt 裡——你得先寫完第六章(Valve 為什麼選 AMD)、再寫完第七章(CUDA 為什麼撬不開),才能回頭看見那條線。

小說也有灰色地帶的定性。「管理層是在說謊,還是真心相信自己的版本?」——寫到第十八章才發現答案是「都不是——他們的計算已經變成本能,面具跟臉融在一起了」。這個判斷同樣精確,同樣不是 AI 能替你做的。

但兩者的差別在於:小說的灰色地帶是人性的灰色——你靠的是對人的理解。非虛構的灰色地帶是因果的灰色——你靠的是對系統的理解。AI 對兩者都有盲點,但盲點的形狀不同。

AI 處理人性灰色的盲點是:它傾向讓角色太理性、太自知、太快看清局面。修正方向是壓低角色的認知,保持模糊。

AI 處理因果灰色的盲點是:它傾向給出「兩面都有道理」的平衡論述,迴避下判斷。修正方向是逼它(或者更準確地說,逼你自己)做出精確的定性——不是「有好有壞」,而是「在什麼條件下好、在什麼條件下壞、條件的差異是什麼」。

五、規則的演化方向不同

小說的禁忌清單從十條長到一百零八條。演化方向是單軸深鑽——在同一個認知框架裡越挖越細。第一版的禁忌是「不要讓主角知道真相」——粗顆粒。到了第一百零八條,禁忌已經精細到「不可以把同事的財務壓力寫成假的或自找的——壓力是真的,但來源是高槓桿選擇」。方向沒有變,精度在提高。

《遊戲致勝》的規則演化方向是結構性重組。

寫到第六章,發現「鎖」不只是一個 pattern,而是有深度維度的——DirectX 是淺鎖(一層 API,可以被翻譯),CUDA 是深鎖(四層疊加,不可能被翻譯)。這個發現不是在已有框架裡加細節,是框架本身升級了。outline 的 pattern 追蹤表從一維(「便利 → 鎖定 → 壟斷」的變奏)升級成三維(變奏方向 × 鎖的深度 × NVIDIA 閉源策略的雙重結局)。

再到第十一章,「三種鎖,三種結局」的框架出現——擴散型、圍牆型、無鎖——又一次結構性重組。終章的收束邏輯因此從「有鎖 vs 無鎖」的二分法,變成了更有分析深度的三分法。

小說的規則演化像磨刀——同一把刀,越磨越利。非虛構的規則演化像換地圖——你以為自己在平原上打仗,走了六章才發現地形是三維的,有些戰場在地下。

而每一次換地圖,都意味著要回頭檢查之前所有章節的論點有沒有被新框架推翻。第六章的發現要倒灌回第二章——讀者讀完第二章時對「鎖」的理解,必須能承接第七章的升級。第十一章的發現要倒灌回終章——計數要改、鏡子段落要改、全書的最終算術要改。

小說不需要這種倒灌。角色在第十八章的認知變化不會推翻第三章的場景——因為第三章的場景在角色的時間線上是固定的。非虛構的時間線不是角色的——是論點的。論點一旦升級,所有章節的論點都要重新校準。

六、AI 是鏡子,但兩面鏡子照出不同的東西

AI 最重要的功能不是產出,是反射。你講一段,AI 反射回來,你看著那個反射,知道哪裡對、哪裡不對。

這個觀察在非虛構寫作裡一樣成立——但鏡子照出的東西不同。

小說的鏡子照出的是你對人的理解的缺口。AI 寫了一段「技術上沒錯」的場景,你讀完覺得假——那個「假」的感覺,就是鏡子在告訴你:你對這個角色在這個時刻的內在狀態,還沒有想透。

非虛構的鏡子照出的是你對系統的理解的缺口。AI 寫了一段「邏輯自洽」的論述,你讀完覺得淺——那個「淺」的感覺,就是鏡子在告訴你:你對這段歷史的因果結構,只看到了表層。

第七章 CUDA 的四層鎖,最初的草稿只寫了兩層(硬體指令集和函式庫)。AI 的產出讓我覺得「對,但不夠」。那個「不夠」逼我去想:還有什麼是 AI 沒寫出來、我自己也還沒想清楚的?然後第三層(框架綁定)和第四層(知識綁定)才被逼出來。特別是第四層——「全球大學的 GPU 計算課程用 CUDA 教、教科書用 CUDA 寫範例、Stack Overflow 上 CUDA 的回答比 ROCm 多五十倍」——這一層不是技術鎖定,是認知鎖定。它改變了整個論點的重量。

AI 沒有發現第四層。我也不是靠靈感發現的。是 AI 的產出不夠好,逼我去追問「為什麼不夠好」,追問的過程把我推到了一個我自己原本也沒到達的地方。

鏡子的價值不在於它照出什麼。在於你被迫面對自己模糊的部分。這一點,兩種寫作是一樣的。

七、兩種難度,同一個不可外包的核心

寫完兩本書之後,我的結論是:

公式 vs 心法的區分,只是第一層。真正的區分是:你在判斷什麼?

小說的判斷是:這個人在這個時空裡,能不能說出這句話?(認知位置) 非虛構的判斷是:這段歷史,該用什麼框架來看?(因果結構)

兩種判斷都不能外包給 AI。但失敗的方式不同:

小說的 AI 失敗是風格漂移——角色太清醒、太早命名。你能感覺到。修正靠直覺。 非虛構的 AI 失敗有三種——事實錯誤(你感覺不到)、框架太淺(你能感覺到但需要時間追問)、灰色地帶的定性被抹平(AI 天生傾向平衡論述)。修正靠直覺加領域知識——而領域知識只有你自己有。

小說的規則演化是磨刀——方向不變,精度提高。 非虛構的規則演化是換地圖——框架本身在寫作過程中被自己的發現改造。

但兩者有一個共同的核心,不會因為題材不同而改變:

你必須對自己正在做的事情有足夠深的理解,深到你可以判斷 AI 的每一個產出是「對」還是「接近但不對」。

那個判斷力,沒有 prompt 可以外包。不論你寫的是小說還是科技史。

差別只在於,小說的「接近但不對」藏在角色的一句台詞裡。科技史的「接近但不對」可能藏在一個你以為正確的年份裡、一個你以為自洽的框架裡、或者一個你以為是事實但其實是價值觀判斷的句子裡。

後者更危險。因為它不觸發直覺——而且 AI 跟你一起盲。

所以非虛構的 AI 協作,比小說多一道前提:你自己得先懂。 不是「懂得用 AI」,是懂你正在寫的那個領域——懂到你能從記憶裡撈出 AI 不會替你搜的反例,懂到你知道哪個數字需要查、哪條因果鏈需要懷疑。AI 的核查能力只在你指對方向的時候才有用。方向本身,是你幾十年的底層認知決定的。

這不是紀律問題。紀律能幫你在交稿後多查幾個數字。但「任天堂到底有沒有平台鎖定」這種問題,紀律查不出來——只有你自己知道 10NES 存在,才會問這個問題。

所以最終的結論比第一篇文章更尖銳:AI 協作不只是「判斷力不能外包」。是領域知識不能外包。而領域知識不是你讀了幾篇文章就有的——是你在那個領域裡泡了幾十年、犯過錯、修正過認知、累積出一套直覺之後才有的。

AI 放大的是你已有的判斷力。你有多深,它就能幫你走多遠。你的盲區,就是它的盲區。

作者用 AI 工具寫了一本文學小說和一本科技史著作。AI 在兩個項目中擔任的角色是鏡子、草稿產生器、和品質檢查工具。所有創作決定和價值觀判斷由作者做出。