AI 曼哈頓計畫及教會行動與禱告呼籲

1. 官方提案與政治表述

美國國會委員會(USCC)

2024 年 11 月,美中經濟與安全審查委員會(USCC)建議美國國會成立並資助一個像「曼哈頓計畫」那樣的大型專案,專門用來加速並取得通用人工智能(AGI)技術。這個提案把 AGI 的開發比作當年的原子彈競賽,認為應該投入大量資金並優先推進,以便在這方面領先中國。[1]

政治措辭

美國能源部長克里斯·賴特(Chris Wright)在談到國家的 AI 發展,特別是超級運算基礎設施時說,美國正站在「新的曼哈頓計畫的開端」。[2]

同樣,Google 執行長桑達爾·皮查伊(Sundar Pichai)也表示願意支持類似的計畫,並強調應該推動國家層面的 AI 基礎設施合作專案。[3]

2. 各界的回應

像前 Google 執行長埃里克·施密特(Eric Schmidt)、Dan Hendrycks 和 Alexandr Wang 等知名人士,曾聯名撰寫政策論文《超級智慧策略》(Superintelligence Strategy),警告不要推動 AGI 版的曼哈頓計畫。他們認為,這種由美國主導的激進競賽,可能引發中國等競爭國的報復,並危害全球安全。相反,他們建議採取以遏制和謹慎為核心的策略。[4]

媒體和評論界常用這個比喻。一篇 Medium 專欄寫道:「AI 是新的曼哈頓計畫」,把現在的 AI 競賽比作當年開發原子彈時的緊迫感和影響,認為這是改變文明的重要轉折點。[5] 最近,OpenAI 執行長山姆·奧特曼(Sam Altman)把即將推出的 GPT-5 模型的威力,比作曼哈頓計畫。他說,在看到它的能力後,他感到自己「無力」,這也凸顯了這次技術飛躍的變革性,甚至帶來一點令人不安的感覺。[6]

3. 什麼是「曼哈頓計畫」?

1938 年,科學家發現了核裂變(核分裂)現象,讓核武的可能性出現。1939 年,物理學家蕭特(Leo Szilard)透過愛因斯坦向美國總統羅斯福提出警告,說納粹德國可能正在研發「超強大威力的炸彈」,這讓美國開始重視核能研究。

1942 年,美國把相關研究納入「曼哈頓工程區」(Manhattan Engineer District),這就是後來大家所說的「曼哈頓計畫」的正式名稱,由陸軍工兵部隊負責管理。

4. AI 曼哈頓計畫與核能研究曼哈頓計畫之間的相似性

(a) 緊迫性與國家層級資源動員:

核能研究的曼哈頓計畫在二戰時由美國主導,集中大量資源和科學家,以最高戰略優先度完成原子彈研發。今天,也有人呼籲政府用同樣的方式,大規模投入資源,加速通用人工智慧(AGI)的發展,並以國家安全和科技領先為理由推進。

(b) 科技跨越性的發展:

曼哈頓計畫展現了少數年時間內從核裂變理論到原子彈實驗的驚人技術突破。同樣,AI 從 2009 年深度學習技術興起後,進展為 GPT、圖像生成等強大工具的過程,也展現了類似的加速演進。[7]

(c) 集中性、秘密性與控制難度:

曼哈頓計畫具有高度機密與中央主導特性;部分推動 AI 的聲音也提倡領先、集中掌控,但 AI 領域顯然更開放、多元,也伴隨分散研發與套件式創新。

(d) 風險與全球責任:

曼哈頓計畫最終導致原子彈被投下,並徹底改變了世界秩序。今天,也有人警告,如果 AGI 發展過於急躁,可能引發類似「相互保證毀滅」(Mutual Assured Destruction)的新型科技對抗,甚至出現所謂 “Mutual Assured AI Malfunction(MAIM)” 的風險局面。

「相互保證毀滅」(Mutual Assured Destruction, MAD):這是一種冷戰時期的核戰略思想,意思是如果兩個擁有大量核武器的國家爆發全面戰爭,雙方都能在被毀滅前,對對方造成毀滅性打擊。結果就是:一旦開戰,不論誰先動手,最後都會同歸於盡。這種「你打我,我也能毀掉你」的恐怖平衡,使得雙方在理論上反而不敢輕易發動核戰。

「相互保證人工智慧故障」(Mutual Assured AI Malfunction, MAIM):這是受 MAD 概念啟發而衍生的說法,用來形容如果多個國家或大型企業在 AGI(通用人工智慧)領域展開激烈競賽,並且缺乏安全機制或合作規範,一旦一方的 AI 系統出現嚴重錯誤或被濫用,可能會引發連鎖反應,導致所有方的 AI 系統同時陷入失控或互相破壞,造成全球性的災難性後果。這是一種針對 AI 時代的「科技版同歸於盡」風險。

(e) 策略與倫理分歧:

有人認為,如果 AI 發展像曼哈頓計畫一樣激進,會忽視公開透明、國際合作和安全管理的重要性;也有人主張,AI 的安全應該由全球多方利益相關者一起協商決定,而不是由單一政府主導。

(f) 影響範圍與不可逆性:

曼哈頓計畫的成果在短時間內就改變了戰爭結果和全球格局;相比之下,AI 的影響更緩慢、深入且持久,一旦普及,就很難回頭。正如一篇 Medium 文章所說,如果像 GPT-5 這樣的 AI 被釋出,它的力量會逐步改變社會結構,而且幾乎不可能收回。[8]

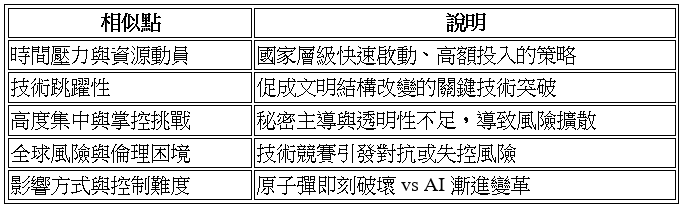

5. 總結及概覽表

「AI 的曼哈頓計畫」這個比喻如今隨處可見——從美國國會的報告、能源政策的表述,到媒體專欄,甚至產業領袖的言論。它之所以引人注目,是因為突出了「急迫性」和「戰略競爭」;但同時,它也激起了關於 AI 應如何治理、資助與部署的激烈討論。

6. 福音派基督徒對政府相關回應之建議方向

(a) 要求成立 AI 倫理諮詢委員會:

福音派領袖曾致函總統,建議組建由信仰者、倫理學者、法律與科技專家組成的「AI 諮詢委員會」,聚焦於 AI 除了“能做什麼”之外,更要考慮“是否應該做”,確保政府政策既尊重倫理原則也不忽視風險。[9], [10]

(b) 提出福音派 AI 原則宣言:

由南方浸信會倫理與宗教自由委員會(ERLC)發布的《福音派 AI 原則宣言》(Evangelical Statement of Principles)與後續 2023 年的正式決議,都強調:

「人的尊嚴必須置於 AI 使用的核心」;

須保持人類在道德決策中的主體性,AI 不可取代人類的道德責任;

技術應被用於造福人群,而非削弱人性或治權集中。[11]

(c) 強調人類屬於神形象的獨特性:

根據 Lausanne Movement 的觀點,福音派堅持「人類因為被造於神的形象(Imago Dei),具有不可侵蝕的人格尊嚴」。他們認為這一立場應成為 AI 政策制定的重要倫理基礎:政府在推動 AI 發展時,應認識到人性價值不可被機器技術所取代。[12]

(d) 呼籲 AI 發展中秉持公義與負責任控制:

福音派強調,AI 的發展必須兼顧正義、公平與透明的管控,並堅持「人不可被降格為資料點」的立場,反對國家或企業藉由 AI 擴大監控、壓迫或侵犯人權。因此,他們傾向支持政府制定 AI 的規範與監督機制。[13]

(e) 「AI 的曼哈頓計畫」的代禱事項

智慧與分辨力:求上帝賜予政策制定者、科學家與企業領袖智慧,能在推動 AI 發展時辨明何為益處、何為危害。

公義與公平:求主保守 AI 技術的應用能促進社會公義,避免加劇貧富差距、種族歧視或社會不平等。

透明與問責:為全球各國政府和企業在 AI 領域保持公開透明,建立有效的監督與問責機制禱告。

和平與國際合作:求主攔阻因 AI 軍備競賽引發的衝突,促成國際間以和平方式制定安全規範與協議。

保護人權與自由:求神保護人類不被降格為數據或被過度監控,確保 AI 的應用尊重每個人的尊嚴與自由。

科技倫理與安全:為研究團隊與技術開發者能恪守道德界線、重視長遠安全而非短期利益禱告。

教會的見證與回應:求神幫助教會在 AI 議題上發出合乎聖經的聲音,積極參與討論與行動,為真理與公義作見證。

註:

[1] “US commission proposes ‘Manhattan Project-like’ initiative for AI” CouputerWorld (Nov 20, 2024): www.computerworld.co...

[2] “US energy secretary touts nuclear power as tech sector’s thirst for electricity grows” AP News (February 25, 2025): apnews.com/article/n...

[3] “Google CEO eyes AI ‘Manhattan Project’ after Trump inauguration” The Hill (Dec 13, 2024): thehill.com/policy/t...

[4] “Ex-Google CEO Eric Schmidt says an AI 'Manhattan Project' is a bad idea” (Mar 6, 2025): www.businessinsider....

[5] “AI Is The New Manhattan Project” (May 31, 2025): medium.com/utopian/a...

[6] “What have we done?” (Aug 10, 2025): timesofindia.indiati...

[7] “AI is supposedly the new nuclear weapons — but how similar are they, really?” (Jun 29, 2023): www.vox.com/future-p...

[8] “GPT-5 and the Nuclear Threshold in Artificial Intelligence” (August 9, 2025): medium.com/%40denizc...

[9] “Evangelical Leaders Call on Trump to Lead with Godly Wisdom in the Age of AI” (May 22, 2025): www.crosswalk.com/he...

[10] “Evangelical Leaders Urge Trump to Form Council on AI’s Ethical Challenges” (May 25, 2025): www.christianitydail...

[11] “Southern Baptists address the ethics of AI” (July 10, 2023): jasonthacker.com/202...

[12] “What Does it Mean to Be Human?”: lausanne.org/report/...

[13] “Evangelicals raise spiritual questions about artificial intelligence” (April 16, 2019): baptiststandard.com/...