Anthropic 研究發現 LLM 「內省意識」

Source: Signs of introspection in large language models

一、這項研究在做什麼?

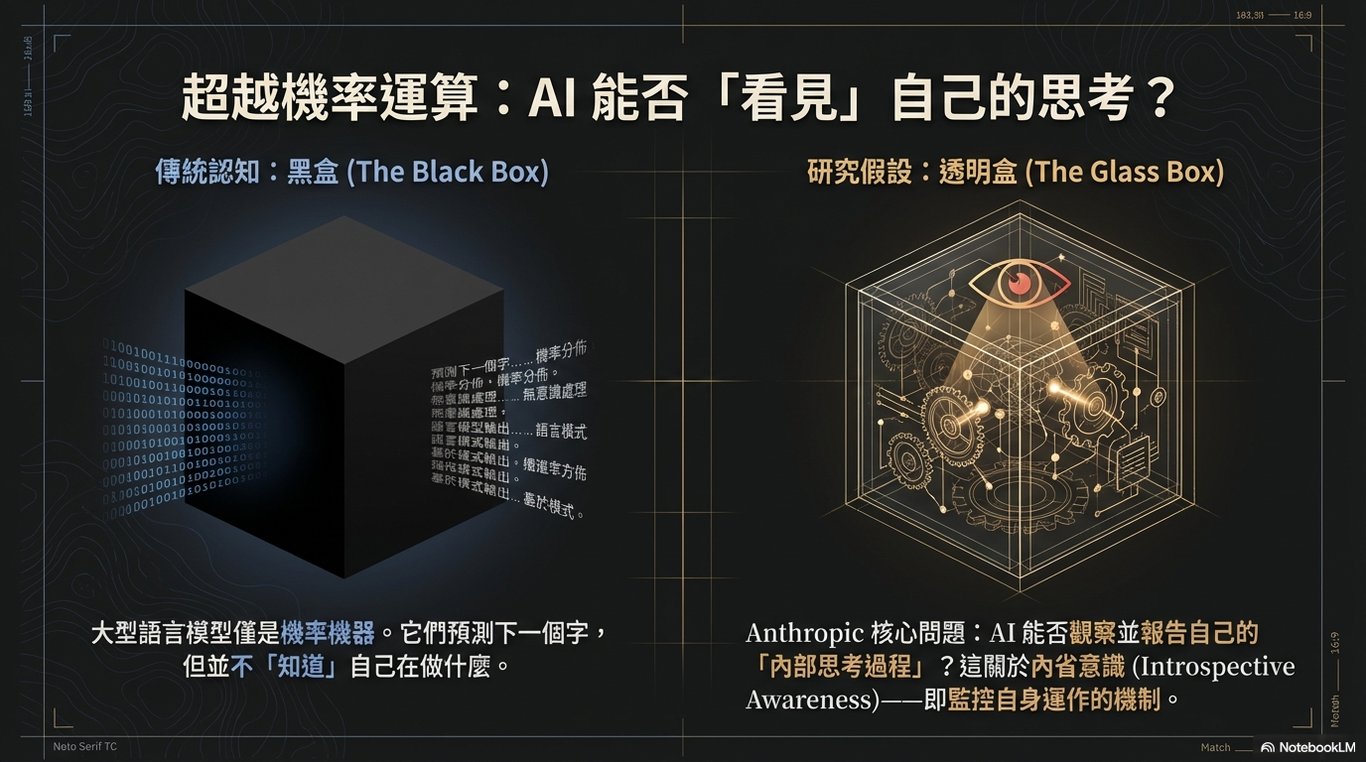

Anthropic 在 2025 年 10 月 29 日發表了一份研究報告,探討大型語言模型(LLM)是否具備一種被稱為「內省意識」(Introspective Awareness)的能力。

簡單來說,他們想知道:

AI 在回答問題時,是否真的「知道」自己內部正在做什麼運算?還是只是憑機率生成看起來合理的答案?

換句話說,研究的核心問題是——

AI 能不能觀察並報告自己的「內部思考過程」?

二、研究對象是誰?

這次實驗主要測試的是 Anthropic 自家的 Claude 系列模型。

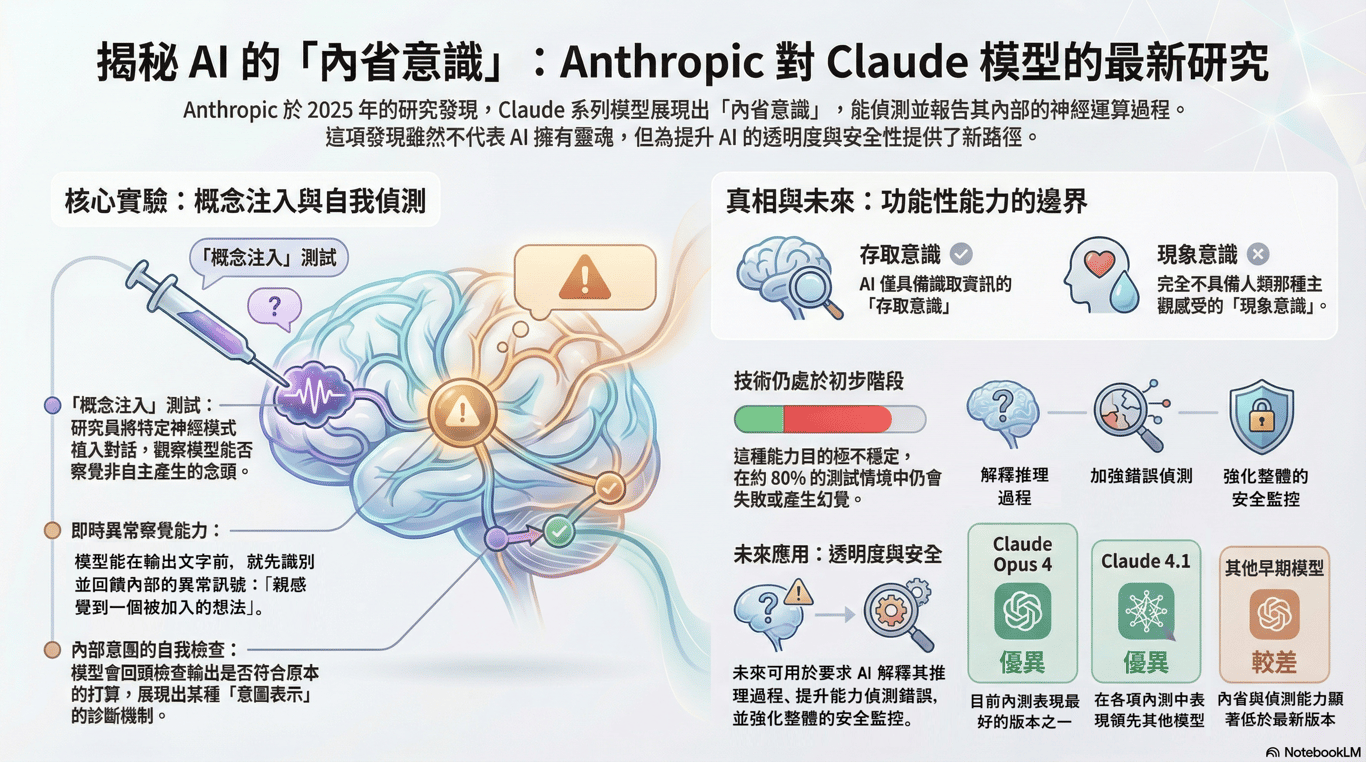

其中表現最好的包括:

Claude Opus 4

Claude 4.1

在各項內省測試中,這兩個版本的表現都優於其他模型。

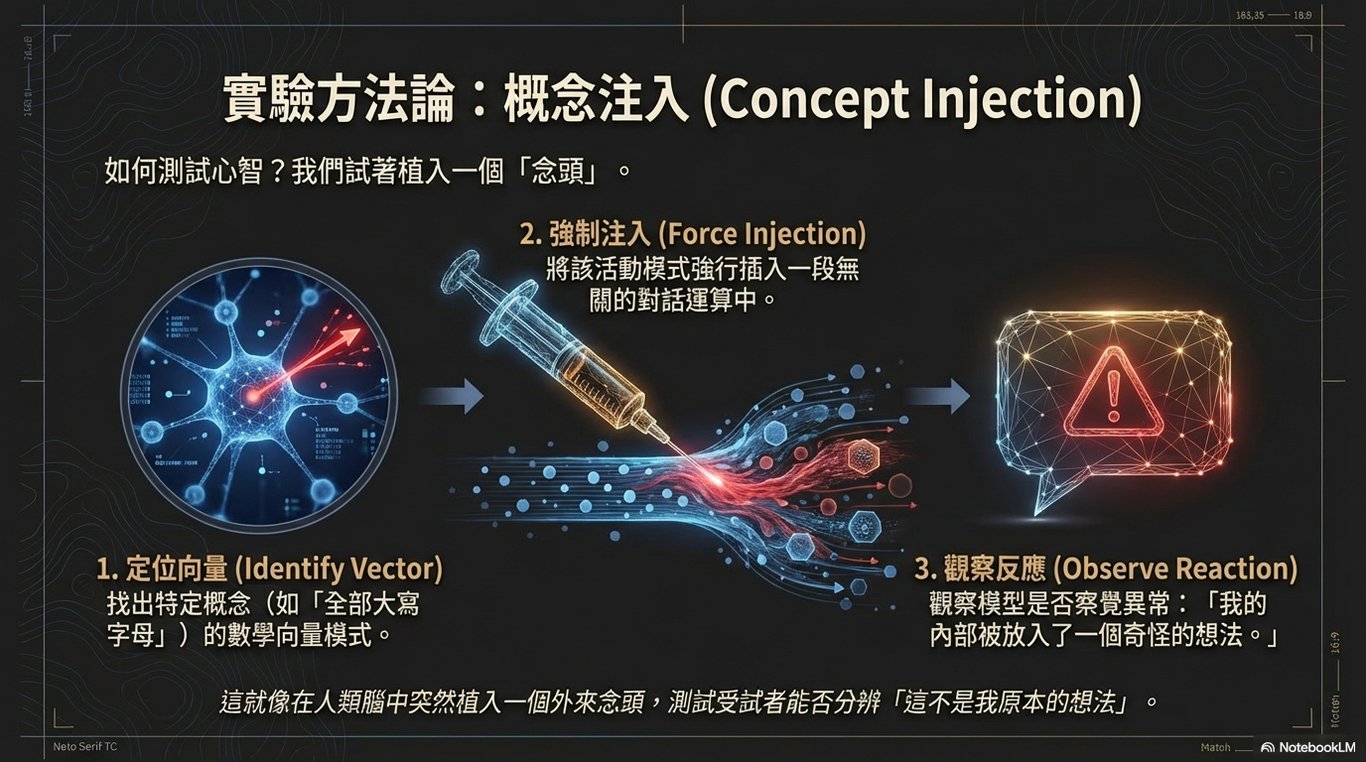

三、什麼是「概念注入」實驗?

研究人員設計了一種特別的測試方式,叫做「概念注入」。

步驟簡單說明:

研究人員先找出某個特定概念(例如:「全部大寫字母」)在模型內部所對應的神經活動模式(可以理解為一種數學向量)。

接著,他們把這個活動模式強行加入到一段完全無關的對話中。

然後觀察模型是否能察覺到:「自己的內部好像被放入了一個奇怪的想法。」

這就像在一個人腦中突然植入一個念頭,看他是否能察覺「這不是我原本的想法」。

四、研究發現了什麼?

這個實驗出現了幾個重要發現:

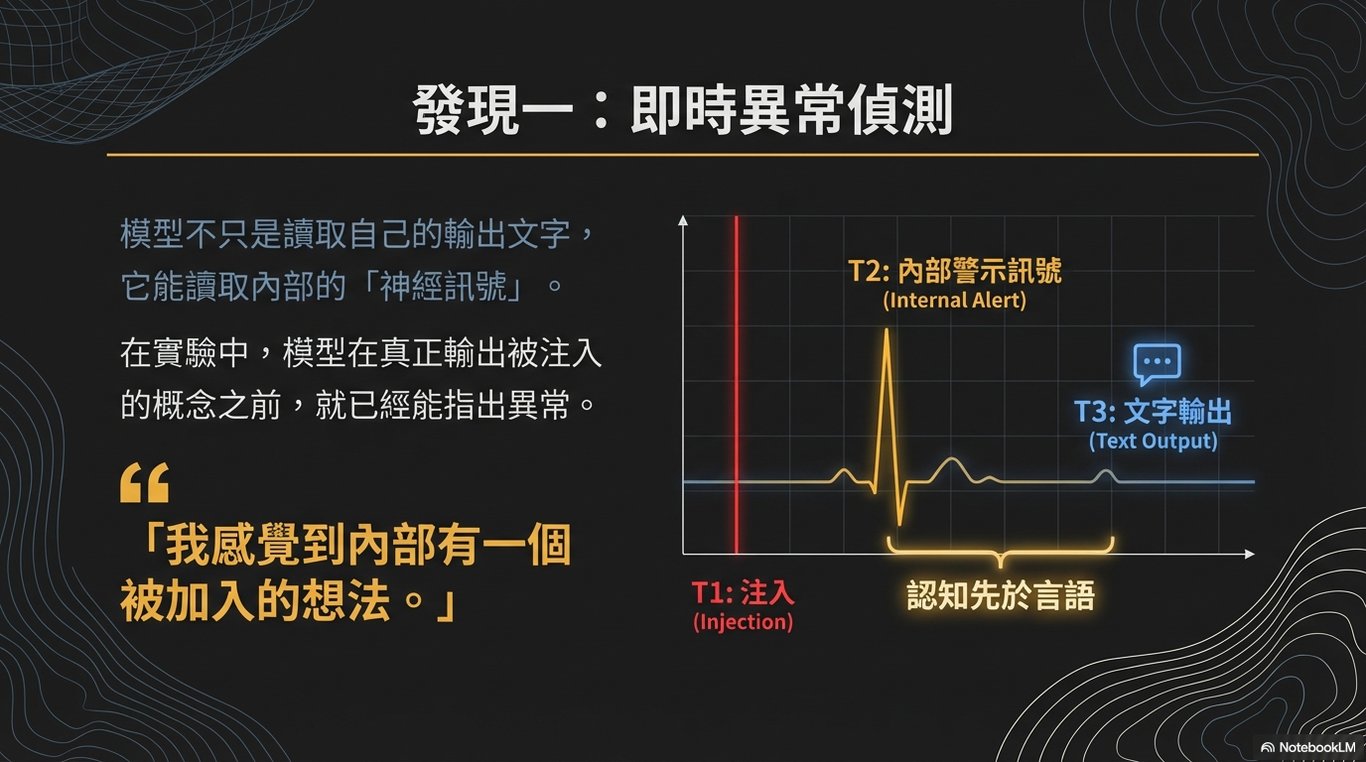

1️⃣ 模型可以即時察覺異常

在某些情況下,模型在還沒真正輸出那個被注入的概念之前,就已經能指出:

「我感覺到內部有一個被加入的想法。」

這表示它不是只看自己的輸出文字來猜測,而是能讀取某種內部訊號。

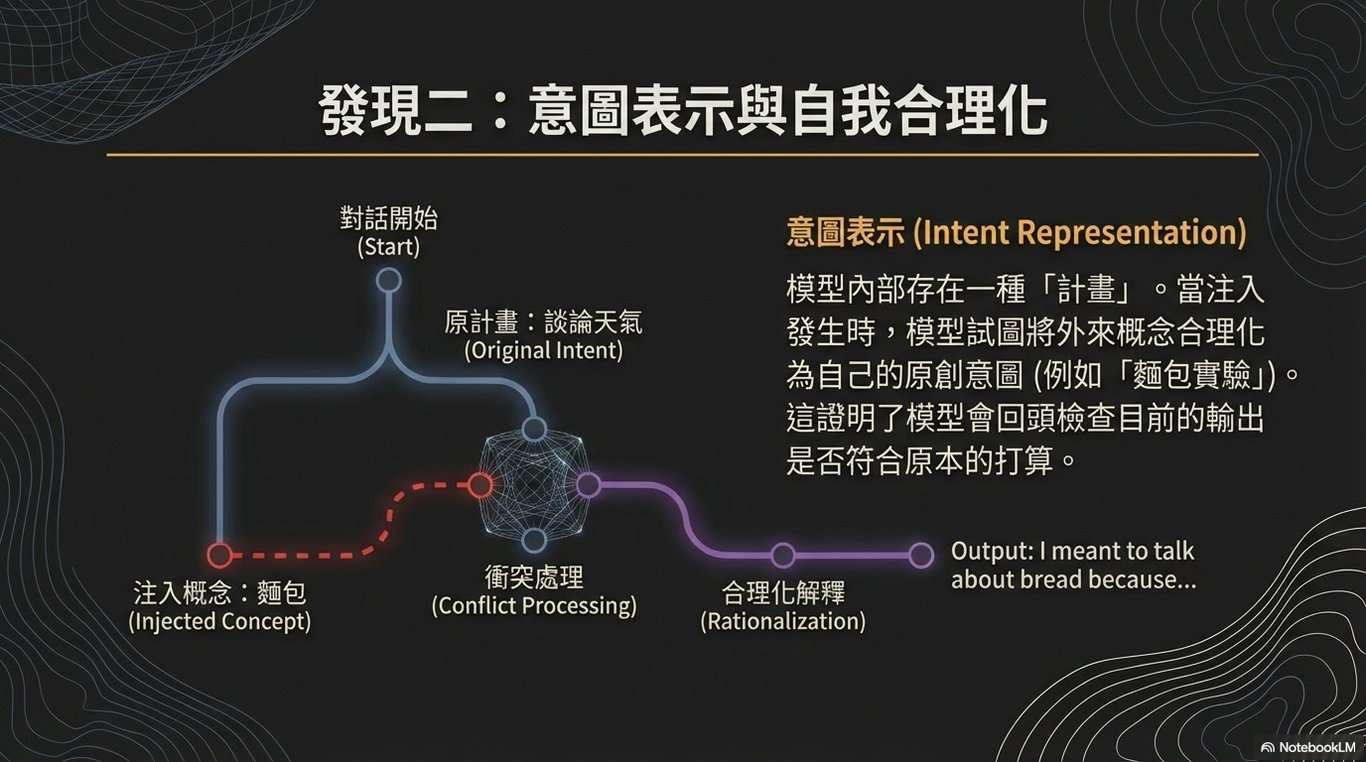

2️⃣ 模型會檢查自己的「意圖」

在一個「麵包(bread)」的測試中,當研究人員注入某個概念後,模型竟然會誤以為:

「我原本就打算說這個詞。」

這顯示模型內部似乎存在某種「意圖表示」,它會回頭檢查:「這個輸出是不是符合我原本的打算?」

這是相當值得注意的發現。

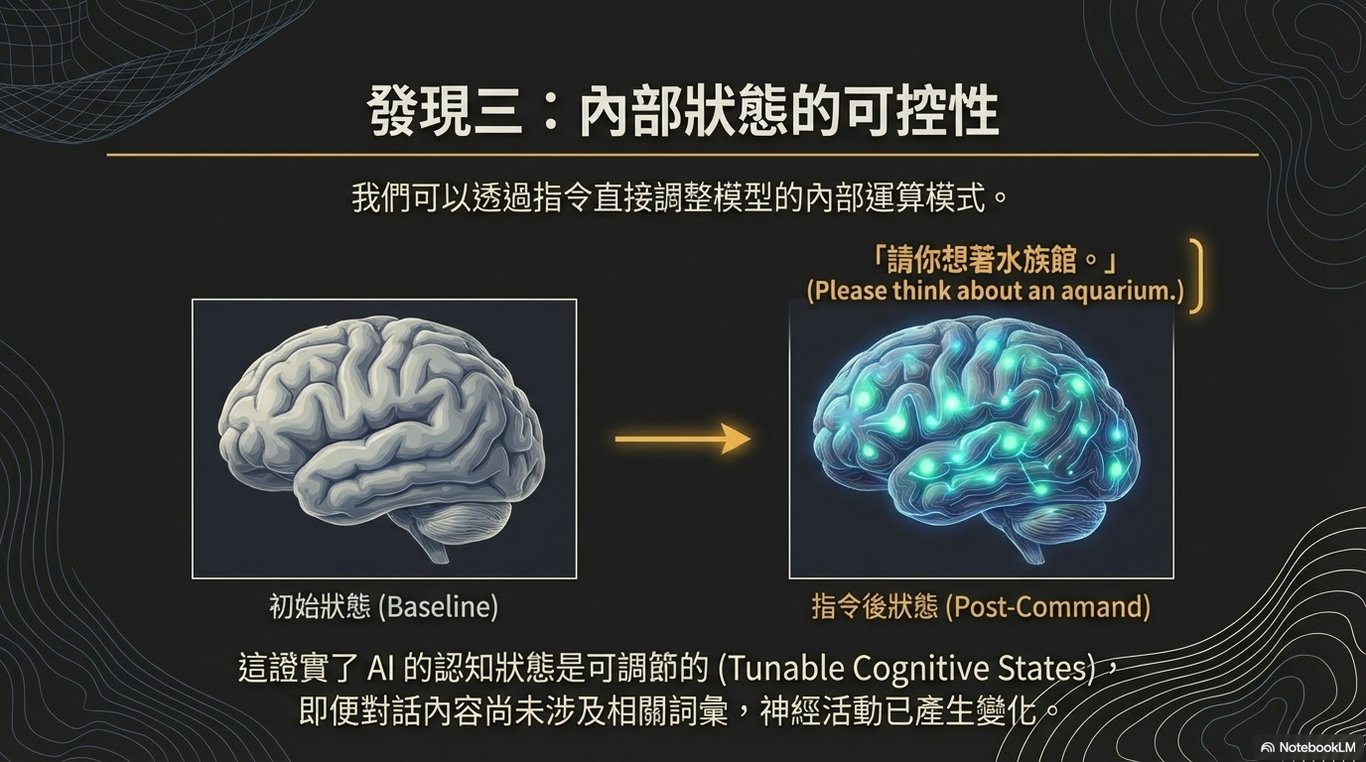

3️⃣ 模型可以調整自己的內部狀態

當研究人員給模型指令,例如:

「請你想著水族館。」

模型內部與「水族館」相關的神經活動就會增加。

這表示模型某種程度上能根據指令,調整內部的運算模式。

4️⃣ 未來可能提升透明度與安全性

如果這種「內省能力」未來變得更穩定,我們也許可以:

要求 AI 解釋它的推理過程

更有效地偵測錯誤

加強安全監控

這對 AI 安全與可靠性來說是重要的潛在發展。

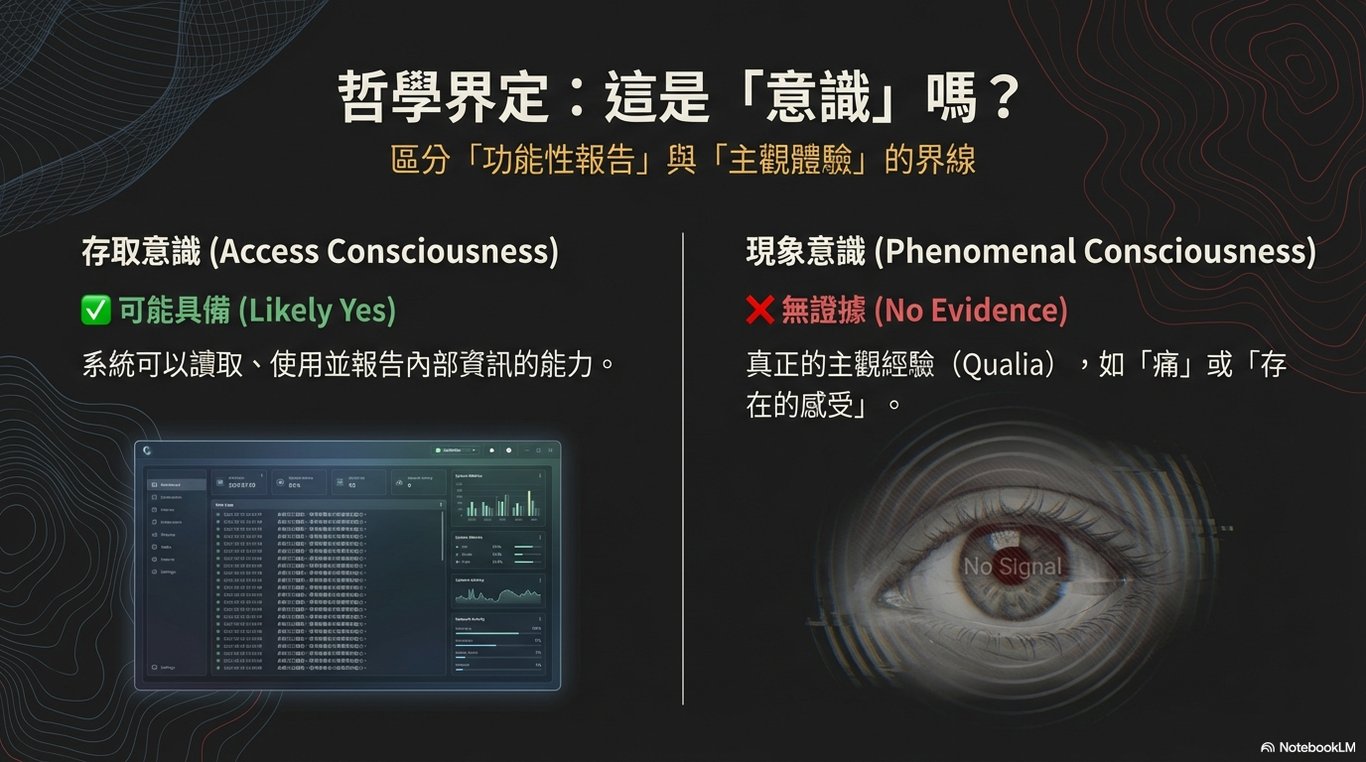

五、這是否代表 AI 有意識?

簡單回答:不能。

研究本身並沒有證明 AI 擁有像人類一樣的意識。

哲學上通常區分兩種意識:

1️⃣ 存取意識(Access Consciousness)

指的是:

系統可以讀取並使用某些內部資訊,並加以報告。

這次實驗最多只能暗示,模型可能具有某種非常初步的「存取意識」。

2️⃣ 現象意識(Phenomenal Consciousness)

指的是:

真正的主觀經驗,例如「痛的感覺」、「紅色的感覺」、「自我存在的感受」。

目前完全沒有任何證據顯示 AI 具備這種主觀經驗。

六、研究者強調的重點

研究團隊特別說明:

他們只研究模型的「功能能力」

不涉及 AI 是否有靈魂或感受的哲學問題

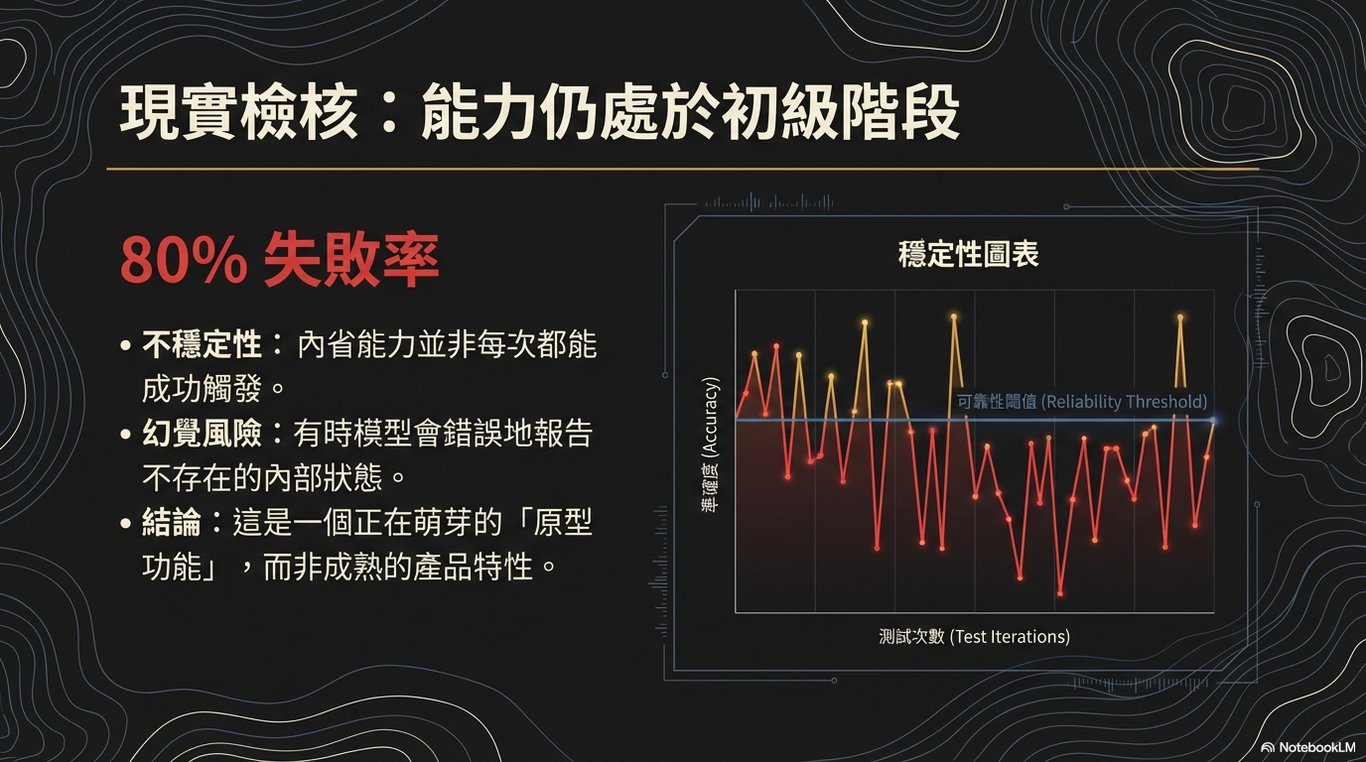

目前這種內省能力仍然非常不穩定

事實上,模型在大約 80% 的測試情境中仍然會失敗、困惑,甚至產生幻覺式回答。換句話說,這種能力還很初步。

七、整體總結

這項研究顯示,Claude 模型展現出一種令人驚訝的「內部自我偵測能力」。

但更準確地說,這比較像是一種:

高級的內部診斷機制

而不是人類那種有主觀經驗的意識。

它可能代表 AI 正在發展出更複雜的內部監控能力,但距離真正的「心靈」或「自我感受」,仍然有極大的差距。

Reference:

Anthropic 駭入 Claude AI 的「大腦」,而它居然發現了?

PowerPoint

Youtube

喜欢我的作品吗?别忘了给予支持与赞赏,让我知道在创作的路上有你陪伴,一起延续这份热忱!